OpenAI GPT-3模型解析及使用指南(openai gpt-3)

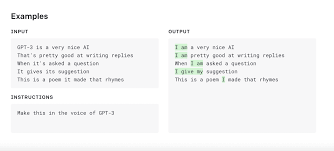

OpenAI GPT-3是一种基于深度学习的语言模型,采用了名为“attention”的技术来替代传统的循环和卷积网络架构。它在自然语言处理任务中表现出色,包括翻译、问答和填空等多个领域。GPT-3是一个自回归模型,通过预测下一个词的方式生成文本。该模型在翻译、问答和填空任务中表现出色,在实时推理方面也具有高性能。此外,GPT-3还具有强大的领域自适应能力。控制生成文本的随机性和多样性的参数是temperature,较高的temperature值会使得文本生成更随机,较低的temperature值则会使得生成结果更一致。参数top_p用于控制生成文本时选择的概率分布范围,较高的top_p值会使得生成结果更具多样性,较低的top_p值则会使得生成结果更集中和确定。参数presence_penalty和frequency_penalty用于对模型在生成文本时存在的重复和频率进行惩罚。